LlamaIndex: เครื่องมือ RAG ยอดนิยมสำหรับแชตบอทคุยกับเอกสาร

LlamaIndex เป็นเครื่องมือสำคัญที่ช่วยให้การสร้างระบบ RAG สำหรับแชตบอทตอบคำถามจากเอกสารทำได้ง่ายและเป็นรูปธรรมมากขึ้น เหมาะทั้งสำหรับผู้เริ่มต้นและองค์กรที่ต้องการพัฒนา AI ให้ตอบจากข้อมูลจริงพร้อมแหล่งอ้างอิง

LlamaIndex: เครื่องมือ RAG ยอดนิยมสำหรับแชตบอทคุยกับเอกสาร

ในช่วงที่หลายองค์กรเริ่มนำ LLM มาใช้งานจริง ปัญหาที่พบได้บ่อยคือโมเดลอาจตอบได้ลื่นไหลและดูมั่นใจ แต่เมื่อถูกถามเกี่ยวกับข้อมูลเฉพาะในเอกสารของบริษัท กลับมีโอกาสตอบผิดหรือเดาเนื้อหาเองได้ง่าย ปัญหานี้ทำให้หลายทีมเริ่มมองหาแนวทางที่ช่วยให้ AI ตอบจากข้อมูลจริง ไม่ใช่จากความน่าจะเป็นเพียงอย่างเดียว

หนึ่งในแนวทางที่ได้รับความนิยมมากคือ RAG (Retrieval-Augmented Generation) ซึ่งมีแนวคิดสำคัญคือ ไม่บังคับให้โมเดลต้องจำทุกอย่าง แต่ให้ระบบค้นข้อมูลที่เกี่ยวข้องจากแหล่งความรู้ก่อน แล้วจึงส่งต่อให้ LLM ใช้เป็นหลักฐานในการสรุปคำตอบ และเครื่องมือที่ถูกพูดถึงมากในสายงานนี้ก็คือ LlamaIndex

RAG คืออะไร และทำไมจึงสำคัญ

RAG คือกระบวนการที่ช่วยให้โมเดลภาษาเข้าถึงข้อมูลภายนอกก่อนตอบคำถาม แทนที่จะอาศัยเฉพาะความรู้ที่มีอยู่เดิมในโมเดล วิธีนี้ช่วยลดการตอบแบบเดา ลดความผิดพลาด และเพิ่มความน่าเชื่อถือของคำตอบอย่างชัดเจน

โดยเฉพาะในงานที่เกี่ยวข้องกับเอกสารบริษัท เช่น นโยบายภายใน คู่มือผลิตภัณฑ์ สรุปประชุม หรือฐานความรู้ที่กระจายอยู่หลายระบบ RAG ช่วยให้แชตบอทสามารถดึงข้อมูลที่เกี่ยวข้องมาใช้อ้างอิงได้จริง

LlamaIndex ช่วยอะไรในงาน RAG

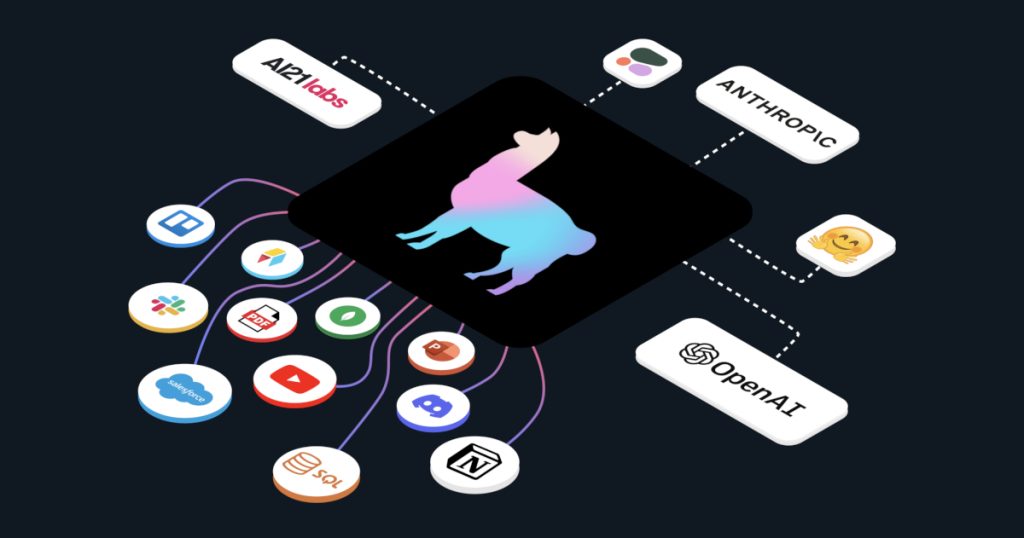

LlamaIndex ทำหน้าที่เป็นตัวเชื่อมระหว่างแหล่งข้อมูลกับ LLM ช่วยลดความซับซ้อนของงานตั้งแต่ต้นทางจนถึงปลายทาง ทำให้นักพัฒนาสามารถเริ่มต้นสร้างระบบถาม-ตอบจากเอกสารได้เร็วขึ้น

ภาพรวมงานหลักที่ LlamaIndex รองรับมีดังนี้

- Ingest: อ่านไฟล์หรือดึงข้อมูลจากหลายแหล่ง

- Chunk: แบ่งเอกสารออกเป็นส่วนย่อยที่เหมาะกับการค้น

- Index: สร้างดัชนีเพื่อให้ค้นหาได้รวดเร็ว มักอาศัย embedding

- Retrieve: ดึงเนื้อหาที่เกี่ยวข้องกับคำถาม

- Synthesize: ส่งข้อมูลที่ค้นเจอให้ LLM สรุปและเรียบเรียงเป็นคำตอบ

จุดเด่นคือ LlamaIndex ไม่ได้รองรับแค่ไฟล์ PDF เท่านั้น แต่ยังเชื่อมต่อกับแหล่งข้อมูลอย่าง Google Drive, Notion, Confluence, Slack, Git, เว็บไซต์ และฐานข้อมูลได้อีกด้วย จึงเหมาะมากกับองค์กรที่มีความรู้กระจายอยู่หลายที่

เรื่องที่มักถูกมองข้าม: การแบ่ง Chunk สำคัญมาก

หลายคนโฟกัสกับการเลือกโมเดลเป็นหลัก แต่ในระบบ RAG นั้น การแบ่งเอกสารเป็น chunk มีผลต่อคุณภาพคำตอบอย่างมาก

- หาก chunk เล็กเกินไป ข้อมูลอาจขาดบริบท

- หาก chunk ใหญ่เกินไป การค้นหาอาจช้าลงและเลือกหลักฐานได้ไม่แม่น

สำหรับเอกสารภาษาไทย แนวทางเริ่มต้นที่มักใช้ได้ผลคือ

- ขนาด chunk ประมาณ 400–800 tokens

- ตั้งค่า overlap ราว 10–20%

หากเอกสารมีความยาวมาก หรือมีหัวข้อย่อยจำนวนมาก อาจค่อย ๆ ปรับขนาด chunk ให้ใหญ่ขึ้นตามความเหมาะสม

Metadata และ Citations คือกุญแจสู่ระบบที่ใช้งานจริง

อีกหนึ่งเทคนิคที่สำคัญคือการเก็บ metadata ตั้งแต่ต้น เช่น ชื่อไฟล์ แผนก วันที่ เวอร์ชัน URL หรือเลขหน้า ข้อมูลเหล่านี้ช่วยให้การค้นแม่นขึ้น สามารถกรองผลลัพธ์ได้ดีขึ้น และยังนำไปใช้แสดงที่มาของคำตอบได้ด้วย

สิ่งที่ทำให้แชตบอทดูพร้อมใช้งานในระดับจริงทันที คือการตอบพร้อม แหล่งอ้างอิง (citations) เพราะผู้ใช้จะเชื่อมั่นมากขึ้น และทีมงานก็สามารถตรวจสอบได้ง่ายว่าคำตอบนั้นอ้างอิงจากเอกสารส่วนใด

ตัวอย่างโปรเจกต์ที่เริ่มต้นได้เร็ว

LlamaIndex เหมาะมากกับการทำโปรเจกต์แรกในสาย AI เชิงใช้งานจริง โดยเฉพาะงานที่สามารถเริ่มจากเอกสารชุดเล็กก่อน ตัวอย่างที่มือใหม่สามารถทำได้ในเวลา 1–2 วัน เช่น

- แชตบอทตอบคำถามเรื่องนโยบายลางานหรือสวัสดิการจากไฟล์ PDF

- แชตบอทค้นบันทึกประชุมและสรุปประเด็นสำคัญจากโน้ต

- แชตบอทตอบคำถามจากคู่มือผลิตภัณฑ์ใน Wiki แบบเป็นขั้นตอน

แนวทางที่ดีสำหรับโปรเจกต์แรกคือ เริ่มจากแหล่งข้อมูลเพียง 1 แบบก่อน เช่น โฟลเดอร์ PDF จากนั้นทำระบบ index และ retrieval ให้ตอบพร้อมอ้างอิงได้ก่อน แล้วค่อยขยายไปยังช่องทางใช้งานจริงอย่าง LINE, Slack หรือ Web ในภายหลัง

เทคนิคเพิ่มความแม่นยำของระบบ RAG

แม้จะมี retrieval แล้ว แต่หากออกแบบไม่ดี ระบบก็ยังอาจพลาดได้ เทคนิคต่อไปนี้ช่วยเพิ่มคุณภาพได้มาก

1. บังคับให้ทุกคำถามผ่าน Retrieval

LLM ไม่ได้ค้นข้อมูลเองโดยอัตโนมัติ หากไม่มีขั้นตอน retrieval มันจะตอบตามความน่าจะเป็น ดังนั้นควรออกแบบให้ทุกคำถามวิ่งผ่านกระบวนการค้นหาก่อนเสมอ

2. ใช้ Hybrid Search

การค้นแบบผสมระหว่าง keyword search และ vector search มักให้ผลดีในเอกสารเชิงเทคนิค เพราะบางคำ เช่น รหัสสินค้า ชื่อฟีเจอร์ หรือคำเฉพาะ อาจค้นด้วย keyword ได้แม่นกว่า

3. ใช้ Query Rewriting

ให้ LLM ช่วยปรับรูปคำถามให้อยู่ในรูปที่เหมาะกับการค้น เช่น เติมคำสำคัญ แยกหัวข้อ หรือขยายความกำกวม วิธีนี้ช่วยเพิ่มโอกาสในการดึงหลักฐานที่เกี่ยวข้องได้มากขึ้น

เช็กลิสต์คุณภาพ RAG แบบง่าย

หากต้องการประเมินว่าระบบ RAG ทำงานได้ดีหรือยัง สามารถใช้เช็กลิสต์พื้นฐานดังนี้

- คำถามนี้ควรมีหลักฐานในเอกสารหรือไม่

- ระบบดึงข้อมูลมาได้กี่ชิ้น และเกี่ยวข้องจริงหรือไม่

- LLM สรุปคำตอบโดยอ้างอิงหลักฐานหรือเปล่า

- หากข้อมูลไม่พอ ระบบตอบได้หรือไม่ว่า “ไม่พบในเอกสาร”

เช็กลิสต์นี้เรียบง่าย แต่ช่วยให้ทีมพัฒนามองเห็นปัญหาได้ชัดเจนทั้งในส่วน retrieval และส่วนการสังเคราะห์คำตอบ

การใช้งานในองค์กรต้องคำนึงถึงสิทธิ์การเข้าถึง

หากต้องการนำระบบไปใช้ในองค์กรจริง ประเด็นสำคัญที่ขาดไม่ได้คือ สิทธิ์การเข้าถึงเอกสาร ไม่ใช่ทุกคนควรเห็นทุกข้อมูล แนวทางที่นิยมคือการกรองเอกสารตาม role หรือ user ในขั้นตอน retrieve เพื่อป้องกันการเปิดเผยข้อมูลที่ไม่ควรถูกเข้าถึง

เรื่องนี้มีความสำคัญไม่แพ้ความแม่นของคำตอบ เพราะระบบที่ตอบเก่งแต่ละเลยด้านความปลอดภัย อาจไม่สามารถนำไปใช้จริงในระดับองค์กรได้

สรุป

LlamaIndex เป็นเครื่องมือที่ช่วยให้การสร้างระบบ RAG เป็นเรื่องที่จับต้องได้มากขึ้น ตั้งแต่การดึงข้อมูล แบ่งเอกสาร สร้างดัชนี ค้นหาหลักฐาน ไปจนถึงส่งต่อให้ LLM สรุปคำตอบอย่างมีที่มา

สำหรับผู้ที่มีเอกสารส่วนตัว บันทึกความรู้ หรือข้อมูลบริษัทจำนวนมาก การเริ่มต้นด้วย LlamaIndex ถือเป็นโปรเจกต์ที่คุ้มค่าอย่างยิ่ง เพราะมันช่วยเปลี่ยนจาก “แชตบอทที่พูดเก่ง” ไปสู่ “แชตบอทที่ตอบจากเอกสารของเราได้จริง” และนั่นคือก้าวสำคัญของการนำ AI ไปใช้งานอย่างมีประสิทธิภาพในโลกจริง