LangChain คืออะไร และช่วยสร้างแอป LLM ให้เป็นระบบได้อย่างไร

LangChain ไม่ได้ทำให้โมเดลภาษาเก่งขึ้นโดยตรง แต่ช่วยให้การเชื่อมต่อโมเดล ข้อมูล และเครื่องมือต่าง ๆ เป็นระเบียบและพัฒนาได้ง่ายขึ้น เหมาะสำหรับผู้ที่ต้องการสร้างแชตบอทหรือระบบ AI ที่ใช้งานได้จริงในงานโปรดักชัน

LangChain คืออะไร และทำไมคนทำแอป LLM ควรรู้จัก

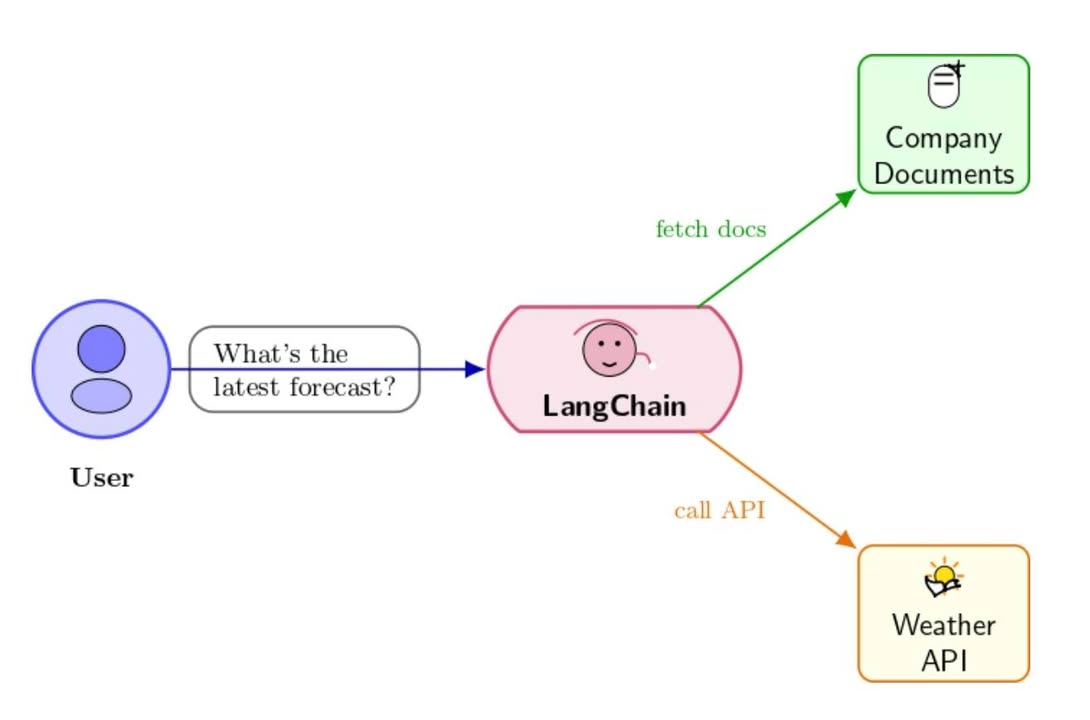

หลายคนเริ่มต้นทำแชตบอทหรือระบบ AI ด้วย LLM แล้วพบปัญหาคล้ายกัน เช่น โค้ดยุ่งเมื่อเชื่อมหลาย API, อยากให้บอทอ่านเอกสารหรือเว็บไซต์ได้, ต้องการให้โมเดลเรียกใช้เครื่องมือภายนอก หรืออยากสร้างเอเจนต์ที่ทำงานหลายขั้นตอนต่อเนื่อง

LangChain ไม่ได้ทำให้โมเดล “ฉลาดขึ้น” ในเชิงความสามารถพื้นฐานของโมเดล แต่ช่วยให้การประกอบส่วนต่าง ๆ ของระบบเป็นระเบียบขึ้นอย่างมาก เปรียบเหมือนชุดเครื่องมือที่ช่วยจัดการโครงสร้างงานรอบ ๆ LLM ให้พัฒนา ทดสอบ และต่อยอดได้ง่ายกว่าเดิม

ปัญหาที่ LangChain ช่วยจัดการ

เมื่อต้องสร้างระบบด้วย LLM จริง ๆ ความท้าทายมักไม่ได้อยู่แค่การเรียกโมเดลหนึ่งครั้ง แต่เป็นเรื่องของการเชื่อมหลายส่วนเข้าด้วยกัน เช่น

- การเรียกใช้หลาย API พร้อมกันจนโค้ดเริ่มดูแลยาก

- การทำให้บอทเข้าถึงข้อมูลจากไฟล์ PDF เว็บ หรือเอกสารภายในองค์กร

- การเปิดให้โมเดลเรียกเครื่องมือ เช่น ค้นฐานข้อมูล ส่งอีเมล หรือคำนวณ

- การออกแบบลำดับงานหลายสเต็ปให้ตอบโจทย์งานจริง

LangChain ถูกออกแบบมาเพื่อช่วยแก้ปัญหาเหล่านี้ด้วยแนวคิดแบบแยกเป็นชิ้นส่วน แล้วนำมาประกอบกันเป็นระบบได้อย่างยืดหยุ่น

องค์ประกอบสำคัญที่ควรรู้

1) Model และ Chat Model

จุดเริ่มต้นคือการเลือก LLM ที่ต้องการใช้งาน เช่น OpenAI, Anthropic, Google หรือโมเดลโลคอล การมี abstraction ที่ดีช่วยให้สามารถเปลี่ยนผู้ให้บริการหรือทดลองหลายโมเดลได้สะดวกขึ้นโดยไม่ต้องรื้อระบบทั้งหมด

2) Prompt Template

แทนที่จะเขียน prompt แบบต่อสตริงยาว ๆ การใช้แม่แบบช่วยให้กำหนดโครงสร้างข้อความและส่งตัวแปรเข้าไปได้อย่างชัดเจน ข้อดีคือแก้ไข prompt ได้ง่ายขึ้นในงานจริง และลดความเสี่ยงที่การปรับคำสั่งจะกระทบส่วนอื่นของระบบ

3) Output Parser

เมื่อคำตอบจากโมเดลต้องถูกส่งต่อให้โค้ดทำงานต่อ การได้ผลลัพธ์ในรูปแบบที่คาดเดาได้มีความสำคัญมาก Output Parser ช่วยแปลงคำตอบให้อยู่ในรูปแบบโครงสร้าง เช่น JSON หรือฟิลด์ต่าง ๆ ทำให้ระบบเสถียรและลดปัญหาคำตอบหลุดฟอร์แมต

4) Chain

Chain คือการนำหลายองค์ประกอบมาต่อกันเป็นลำดับขั้น เช่น Prompt → LLM → Parser → ฟังก์ชันภายในระบบ เหมาะกับงานที่มีขั้นตอนค่อนข้างชัดเจน เช่น สรุปข้อความ จัดหมวดหมู่ และสร้างรายการงานต่อเนื่อง

5) Tool และ Function Calling

จุดเด่นสำคัญของระบบ LLM ยุคใหม่คือการให้โมเดลเรียกใช้ความสามารถภายนอกได้ เช่น ค้นเอกสาร คิวรีฐานข้อมูล เรียก API ภายใน หรือสร้างตั๋วงานในระบบอย่าง Jira ความสามารถนี้ทำให้ LLM ไม่ได้มีหน้าที่แค่ตอบข้อความ แต่สามารถมีบทบาทในเวิร์กโฟลว์จริงขององค์กรได้

6) Memory

Memory ช่วยให้บทสนทนาดูต่อเนื่องและมีบริบท แต่สิ่งสำคัญคือไม่จำเป็นต้องเก็บแชตทั้งหมดทุกครั้งเสมอไป วิธีที่มักมีประสิทธิภาพกว่าคือสรุปสาระสำคัญของบทสนทนาให้อยู่ในรูปแบบ state สั้น ๆ แล้วเก็บไว้แทน วิธีนี้ช่วยลดการใช้ token และลดโอกาสที่โมเดลจะหลุดประเด็น

7) Retrieval และ RAG

หากต้องการให้บอทตอบจากเอกสารหรือข้อมูลขององค์กรอย่างมีหลักฐาน RAG คือแนวทางที่สำคัญมาก โดยทั่วไปกระบวนการจะเริ่มจากแยกเอกสารเป็นส่วนย่อย ทำ embedding เก็บไว้ใน vector database แล้วค้นหาส่วนที่เกี่ยวข้องเมื่อมีคำถาม ก่อนส่งข้อมูลนั้นให้ LLM ใช้ประกอบการตอบ

ข้อดีของ RAG คือช่วยให้ระบบส่งเฉพาะข้อมูลที่เกี่ยวข้องจริง แทนการยัดเอกสารทั้งก้อนเข้าไปใน prompt ซึ่งมักสิ้นเปลือง token เกินจำเป็นและอาจเกินข้อจำกัดของโมเดล

ตัวอย่างงานที่เหมาะกับ LangChain

LangChain เหมาะกับการทำระบบที่ต้องเชื่อม LLM เข้ากับข้อมูลและเครื่องมือจริง ตัวอย่างเช่น

- แชตบอทตอบคำถามจากคู่มือสินค้าในไฟล์ PDF หลายเล่ม

- ผู้ช่วยทีมซัพพอร์ตที่ค้น FAQ และตอบพร้อมลิงก์อ้างอิง

- บอทสรุปประชุมและสร้าง To-do ส่งต่อไปยัง Trello หรือ Notion

- เอเจนต์ตรวจ log แล้วสรุป incident พร้อมแนวทางแก้ไขเบื้องต้น

งานลักษณะนี้มักทำได้เร็วขึ้นมากเมื่อมีเฟรมเวิร์กที่ช่วยจัดโครงสร้างองค์ประกอบต่าง ๆ ไว้ชัดเจน

สิ่งที่มือใหม่ควรรู้ก่อนเริ่ม

เริ่มจาก Chain ก่อนค่อยไป Agent

แม้ Agent จะดูทรงพลังและยืดหยุ่น แต่ก็มักดีบักยากกว่า และมีต้นทุนการใช้งานสูงกว่าในหลายกรณี หากเพิ่งเริ่มต้น ควรเริ่มจาก chain ที่ตรงไปตรงมาก่อน เพื่อให้เข้าใจโฟลว์และควบคุมพฤติกรรมระบบได้ดี

วัดผลด้วยชุดคำถามทดสอบ

การพัฒนาแอป LLM ที่ดีไม่ควรอาศัยความรู้สึกเพียงอย่างเดียว ควรเก็บชุดคำถามจริงจากผู้ใช้ประมาณ 20-50 ข้อ แล้วใช้ทดสอบซ้ำทุกครั้งที่ปรับ prompt หรือระบบ วิธีนี้จะช่วยให้เห็นชัดว่าการเปลี่ยนแปลงทำให้คุณภาพดีขึ้นหรือแย่ลง

ใส่ guardrail ให้ตอบแบบอ้างอิงได้

โดยเฉพาะในระบบ RAG ควรกำหนดรูปแบบคำตอบให้ชัด เช่น ตอบแบบกระชับและแนบแหล่งอ้างอิงจากเอกสารที่ค้นพบ วิธีนี้ช่วยเพิ่มความน่าเชื่อถือและลดการตอบแบบคาดเดา

คุมต้นทุนตั้งแต่วันแรก

ระบบ LLM มีต้นทุนทั้งในด้าน token และ latency หากเริ่มเก็บ log ตั้งแต่ต้น จะช่วยให้ประเมินค่าใช้จ่ายและประสิทธิภาพได้แม่นยำขึ้น และไม่ต้องตกใจเมื่อต้องขยายสู่โปรดักชันจริง

ตัวอย่างภาพการทำงานแบบง่าย

ลองนึกถึงกรณีที่ต้องการสร้างบอทตอบคำถามเรื่องนโยบายลางานจากไฟล์พนักงาน

กระบวนการอาจเป็นดังนี้

- นำไฟล์ PDF นโยบายมาแยกเป็นย่อหน้าหรือ chunk

- สร้าง embedding ของแต่ละส่วน

- เก็บข้อมูลไว้ใน vector database

- เมื่อผู้ใช้ถาม ระบบจะค้น 3 ส่วนที่เกี่ยวข้องที่สุด

- ส่งข้อมูลที่ค้นได้พร้อมกติกาการตอบให้ LLM

- ให้โมเดลตอบโดยอิงจากเอกสารและแนบแหล่งอ้างอิง

ผลลัพธ์ที่ได้จะแตกต่างจากแชตบอทธรรมดา เพราะคำตอบจะยึดโยงกับข้อมูลจริง ลดการเดา และตรวจสอบย้อนกลับได้ง่ายกว่า

ทำไมแนวคิดสำคัญกว่าการท่องโค้ด

การใช้ LangChain ให้ได้ผลไม่ได้อยู่ที่การจำคำสั่งหรือเขียนตามตัวอย่างให้ครบทุกบรรทัด แต่อยู่ที่การเข้าใจว่าในระบบหนึ่ง ๆ ควรแยกหน้าที่อย่างไร ควรใช้ chain ตอนไหน ควรใช้ tool เมื่อไร และควรใช้ RAG ในกรณีใด

เมื่อเข้าใจภาพรวมเหล่านี้แล้ว การเลือกใช้เฟรมเวิร์กหรือสลับไปใช้เครื่องมืออื่นในอนาคตก็จะง่ายขึ้น เพราะแก่นของงานยังคงเป็นเรื่องการออกแบบโฟลว์ข้อมูล การควบคุมคุณภาพคำตอบ และการเชื่อม AI เข้ากับระบบจริง

สรุป

LangChain เหมาะมากสำหรับผู้ที่ต้องการสร้างโปรเจกต์ AI ที่ใช้งานได้จริง เพราะช่วยให้การต่อ LLM เข้ากับข้อมูล เอกสาร และเครื่องมือภายนอกเป็นระบบมากขึ้น

อย่างไรก็ตาม ความสำเร็จของโปรเจกต์ไม่ได้ขึ้นอยู่กับเฟรมเวิร์กเพียงอย่างเดียว แต่ขึ้นอยู่กับการออกแบบโฟลว์ที่ดี การทดสอบอย่างสม่ำเสมอ และการควบคุมต้นทุนตั้งแต่เริ่มต้น หากวางรากฐานสามเรื่องนี้ได้ดี LangChain จะเป็นตัวช่วยที่ทรงพลังอย่างมากในการพัฒนาแอป AI สำหรับงานจริง