Flowise ทางลัดสร้างแชตบอทและระบบ RAG ให้เห็นผลได้ในไม่กี่ชั่วโมง

Flowise คือเครื่องมือแบบลากวางที่ช่วยให้การสร้างแชตบอท ระบบถามตอบเอกสาร และเวิร์กโฟลว์ที่เชื่อมกับ LLM ทำได้เร็วขึ้นมาก เหมาะทั้งสำหรับการทำเดโม การทดลองแนวคิด และการต่อยอดไปสู่งานใช้งานจริงในทีมที่มีทั้งสายเทคนิคและไม่ใ

Flowise ทางลัดสำหรับคนอยากทำแชตบอทและ RAG แบบไม่ต้องเริ่มจากโค้ดยาวๆ

ในช่วงที่เครื่องมือ AI ถูกนำไปใช้กับงานจริงมากขึ้น หนึ่งในโปรเจกต์บน GitHub ที่ได้รับความสนใจอย่างต่อเนื่องคือ Flowise เครื่องมือที่ช่วยให้คุณสร้าง workflow สำหรับแชตบอท ระบบถามตอบเอกสาร หรือระบบที่เชื่อม LLM เข้ากับเครื่องมืออื่นได้ผ่านหน้าจอแบบลากวาง

จุดเด่นของมันไม่ใช่แค่ความใช้งานง่าย แต่คือการทำให้สิ่งที่ปกติอาจใช้เวลาหลายวันในการพัฒนา กลายเป็นเดโมที่ใช้งานได้จริงภายในไม่กี่ชั่วโมง เหมาะมากสำหรับทีมที่อยากพิสูจน์แนวคิดให้เห็นก่อน แล้วค่อยปรับให้แข็งแรงขึ้นในระยะยาว

Flowise คืออะไร และทำงานอย่างไร

แนวคิดหลักของ Flowise คือการสร้าง workflow ด้วยการลากวาง node แล้วเชื่อมต่อกันเหมือนผังงาน แต่ละ node จะมีหน้าที่เฉพาะ เช่น

- รับข้อความจากผู้ใช้

- เรียกใช้งาน LLM

- ดึงข้อมูลจากเอกสาร

- ค้นหาข้อมูลจาก Vector Database

- เรียก API หรือ webhook ภายนอก

โครงสร้างแบบนี้ทำให้ผู้ใช้มองเห็นภาพรวมของระบบได้ง่ายขึ้น ไม่จำเป็นต้องเริ่มจากการเขียนโค้ดทั้งชุดตั้งแต่ต้น และยังช่วยให้การทดลอง ปรับ prompt หรือเปลี่ยนลำดับการทำงานทำได้เร็วมาก

ทำไม Flowise ถึงเหมาะกับงานจริง

แม้หลายคนจะมองว่าเครื่องมือแบบลากวางเหมาะกับเดโมเท่านั้น แต่ Flowise มีความสามารถที่ตอบโจทย์การใช้งานจริงได้ดี โดยเฉพาะในงานที่ต้องพัฒนาและทดสอบเร็ว

1) สร้าง chatflow ที่คิดเผื่อการใช้งานจริง

Flowise รองรับองค์ประกอบสำคัญของระบบแชต เช่น

- memory

- prompt template

- tool calling

- การปรับพารามิเตอร์ต่างๆ ของโมเดล

ทั้งหมดนี้สามารถตั้งค่าได้ผ่าน UI ทำให้ทีมลดเวลาในการประกอบระบบพื้นฐาน และไปโฟกัสกับตรรกะทางธุรกิจได้มากขึ้น

2) ทำระบบ RAG ได้ง่ายกว่าที่คิด

สำหรับคนที่อยากสร้างระบบถามตอบจากเอกสาร Flowise ช่วยให้การเชื่อมส่วนประกอบสำคัญทำได้เป็นเส้นทางเดียว เช่น

Embedding → Vector DB → Retriever → LLM

เมื่อมองเห็น flow ชัดเจน การปรับแต่ง retrieval หรือการทดสอบกับเอกสารจริงก็ทำได้สะดวกขึ้นมาก

3) เชื่อมระบบภายนอกได้เร็ว

แชตบอทที่ดีไม่ควรแค่ “ตอบ” แต่ควร “ทำงาน” ได้ด้วย เช่น ตรวจสถานะงาน ดึงข้อมูลลูกค้า หรือส่งคำขอไปยังระบบภายในองค์กร

Flowise รองรับการเชื่อมต่อกับ

- REST API

- webhook

- ระบบหลังบ้านขององค์กร

ทำให้บอทสามารถกลายเป็นผู้ช่วยที่ทำงานร่วมกับระบบเดิมได้อย่างมีประโยชน์

4) เหมาะกับทีมที่มีทั้ง Dev และ Non-Dev

อีกข้อดีที่สำคัญคือการทำงานร่วมกันในทีม คนที่ไม่ถนัดเขียนโค้ดสามารถช่วยประกอบ flow หรือช่วยออกแบบตรรกะเบื้องต้นได้ ส่วนฝั่งนักพัฒนาก็สามารถโฟกัสกับเรื่องที่ลึกขึ้น เช่น endpoint, authentication, data pipeline หรือการ deploy ระบบ

ตัวอย่าง workflow ที่นำไปใช้ได้จริง

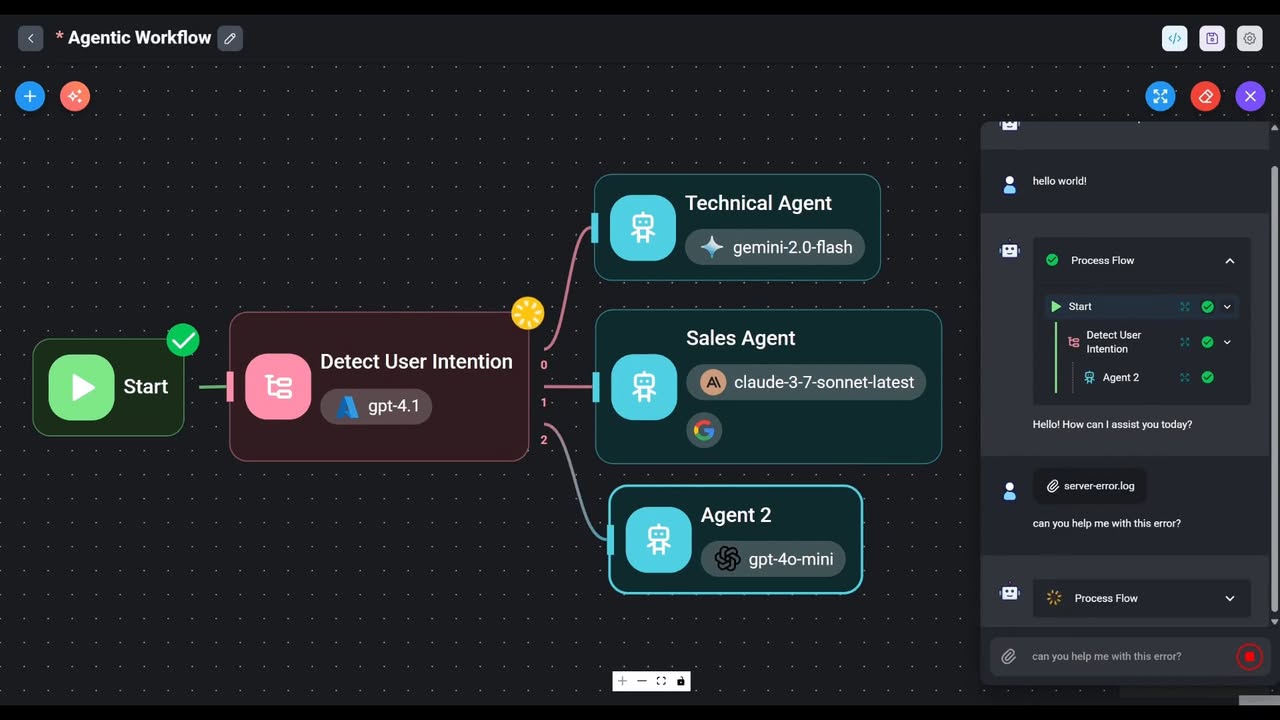

หนึ่งในรูปแบบที่น่าสนใจคือการสร้างแชตบอทที่รับข้อความจากลูกค้า แล้วใช้ router แยกเจตนาของคำถามก่อนเข้าสู่เส้นทางที่เหมาะสม

กรณีถามข้อมูลหรือค้นเอกสาร

ตัวอย่าง flow:

Input → Router → Embedding → Vector Search → Retrieve top-k → Compose context → LLM Answer

แนวทางนี้เหมาะกับระบบ FAQ อัจฉริยะ ฐานความรู้ภายในองค์กร หรือระบบตอบคำถามจากคู่มือและเอกสารนโยบาย

กรณีขอให้ระบบทำรายการ

ตัวอย่าง flow:

Input → Router → LLM → Tool/API Call → Return result → Summarize

เช่น การเช็กสถานะคำสั่งซื้อ เปิด ticket หรือดึงข้อมูลจากระบบหลังบ้าน แล้วสรุปผลลัพธ์ให้อ่านง่ายก่อนส่งกลับผู้ใช้

ทริคใช้งาน Flowise ที่มือใหม่ทำตามได้

ถ้าอยากให้ระบบเสถียรขึ้นตั้งแต่ต้น มีเทคนิคหลายข้อที่ช่วยลดปัญหาได้มาก

ใส่ Guardrail ก่อนเข้า LLM

ควรมี node สำหรับตรวจสอบเนื้อหาก่อนส่งเข้าโมเดล เช่น

- คำหยาบ

- ข้อมูลส่วนตัว

- คำสั่งที่เสี่ยงอันตราย

วิธีนี้ช่วยลดความเสี่ยงและทำให้ระบบมีชั้นป้องกันก่อนประมวลผลจริง

แยก prompt เป็น 2 ชั้น

แนวทางที่ได้ผลดีคือแยกการทำงานของ prompt ออกเป็นสองส่วน

- ชั้นแรก: จัดการงานเชิงโครงสร้าง เช่น intent extraction หรือการดึง entities

- ชั้นสอง: จัดการงานเชิงภาษา เช่น การเรียบเรียงคำตอบให้ลื่นไหล

การแยกแบบนี้ช่วยให้ผลลัพธ์นิ่งขึ้น และปรับปรุงแต่ละส่วนได้ง่ายกว่าใช้ prompt ก้อนเดียว

ตั้งค่า Retrieval ให้เหมาะสม

ในงาน RAG การตั้งค่า retrieval ส่งผลต่อคุณภาพคำตอบอย่างมาก ควรระวังเรื่อง

- ค่า top-k ที่มากหรือน้อยเกินไป

- similarity threshold

- คุณภาพของเอกสารต้นทาง

ถ้าตั้งค่าเหมาะสม จะช่วยลดอาการ hallucination ได้ชัดเจน

ทำคำตอบแบบมีแหล่งอ้างอิง

การให้ระบบตอบพร้อม citations เช่น ชื่อไฟล์ หน้า หรือส่วนของเอกสาร จะช่วยเพิ่มความน่าเชื่อถือให้คำตอบ และยังช่วยให้ผู้ใช้ตรวจสอบย้อนหลังได้ง่ายขึ้น

เก็บ log ให้ใช้ debug ได้จริง

ข้อมูลที่ควรเก็บ เช่น

- input ของผู้ใช้

- รายการ retrieved document IDs

- prompt ที่ส่งเข้าโมเดลจริง

- latency ของแต่ละขั้นตอน

การเก็บ log แบบมีประโยชน์จะช่วยให้ทีมวิเคราะห์ปัญหาและปรับปรุงระบบได้เร็วขึ้นมาก

สิ่งที่ต้องระวังเมื่อนำไปใช้จริง

แม้ Flowise จะช่วยให้เริ่มต้นได้เร็ว แต่การนำไปใช้ใน production ยังต้องวางระบบรอบด้าน

อย่าเชื่อผลลัพธ์จาก LLM เต็มร้อย

ควรมีทั้ง validation และ fallback เสมอ โดยเฉพาะในกรณีที่ข้อมูลผิดพลาดอาจส่งผลกระทบต่อผู้ใช้หรือธุรกิจ

ระวังข้อมูลอ่อนไหวในเอกสารองค์กร

ถ้าใช้เอกสารภายใน ควรจัดการเรื่องสิทธิ์การเข้าถึง การแบ่งระดับผู้ใช้ และการ mask ข้อมูลสำคัญอย่างจริงจัง

ควบคุมค่าใช้จ่ายของโมเดล

หากเรียกใช้โมเดลผ่าน API ค่าใช้จ่ายจะผูกกับจำนวน token ที่ใช้ จึงควรติดตามต้นทุนอย่างต่อเนื่อง และใช้ caching ในคำถามที่ซ้ำกันเพื่อลดค่าใช้จ่าย

แผนเริ่มต้นโปรเจกต์ภายใน 3 ชั่วโมง

สำหรับคนที่อยากทดลองแบบเร็วๆ สามารถเริ่มตามแผนนี้ได้

ชั่วโมงที่ 1: ตั้งระบบพื้นฐาน

- ติดตั้ง Flowise

- เชื่อมโมเดล LLM

- สร้าง chatflow สำหรับตอบคำถามทั่วไป

ชั่วโมงที่ 2: เพิ่มความสามารถด้าน RAG

- นำเอกสาร 10-50 ไฟล์เข้าไปใช้งาน

- ทำ embedding และ vector search

- ปรับ retrieval ให้เหมาะกับประเภทเอกสาร

ชั่วโมงที่ 3: เชื่อมต่อระบบภายนอก

- ต่อ API อย่างน้อย 1 จุด เช่น เช็กสถานะงาน

- ให้ระบบสรุปผลลัพธ์กลับมาในรูปแบบที่ผู้ใช้อ่านง่าย

แนวทางนี้ช่วยให้เห็นภาพของระบบครบทั้งการตอบคำถามจากความรู้และการลงมือทำงานผ่านเครื่องมือจริง

Flowise เหมาะกับใคร

Flowise เหมาะกับหลายกลุ่ม เช่น

- ทีมที่อยากทำต้นแบบ AI ให้เห็นเร็ว

- องค์กรที่ต้องการทดลองระบบ RAG จากเอกสารภายใน

- ทีมผลิตภัณฑ์ที่ต้องการให้คนหลายบทบาทช่วยกันออกแบบ flow

- นักพัฒนาที่อยากใช้เป็นสนามทดลองก่อนแปลงเป็นบริการถาวร

ในทางปฏิบัติ หลายทีมใช้ Flowise เป็นเหมือนพื้นที่ทดลอง เพื่อหา flow ที่ใช่ก่อน แล้วค่อยนำ logic ที่นิ่งแล้วไปพัฒนาเป็น service แบบเต็มรูปแบบ วิธีนี้ช่วยลดความเสี่ยงในการเริ่มต้นได้มาก

สรุป

Flowise เป็นเครื่องมือที่ช่วยย่นระยะทางจากไอเดียไปสู่เดโมและต้นแบบใช้งานได้จริงอย่างมาก โดยเฉพาะสำหรับงานแชตบอท ระบบถามตอบเอกสาร และ workflow ที่ต้องเชื่อม LLM เข้ากับ API หรือระบบภายนอก

จุดแข็งสำคัญของมันคือความเร็วในการประกอบระบบ ความชัดเจนของ flow และความสามารถในการทำงานร่วมกันระหว่างคนเขียนโค้ดกับคนที่ไม่ถนัดโค้ด หากเป้าหมายของคุณคือ “ทำของให้เห็นก่อน” แล้วค่อยปรับให้แน่นขึ้นภายหลัง Flowise ถือเป็นทางลัดที่น่าสนใจมาก