Dify แพลตฟอร์มโอเพนซอร์สที่ช่วยต่อยอดแอป AI สู่โปรดักชัน

Dify คือแพลตฟอร์มโอเพนซอร์สสาย LLM Ops ที่ช่วยให้การสร้างแอป AI ไม่หยุดอยู่แค่เดโม แต่ขยับไปสู่ระบบใช้งานจริงได้ง่ายขึ้น ทั้งด้านแชตบอท, RAG, เวิร์กโฟลว์, การจัดการพรอมป์ต์ และการมอนิเตอร์การใช้งาน.

Dify: แพลตฟอร์มโอเพนซอร์สที่ช่วย “ต่อของให้ครบ” สำหรับงานแอป AI

หลายทีมเริ่มต้นทำแชตบอทหรือแอป AI จากโค้ดเพียงไม่กี่ไฟล์ และอาจรู้สึกว่าไปได้เร็วในช่วงแรก แต่เมื่อจะนำระบบขึ้นใช้งานจริงในระดับโปรดักชัน มักพบกับโจทย์สำคัญที่ไม่ได้ถูกพูดถึงตั้งแต่ต้น เช่น การจัดการพรอมป์ต์หลายเวอร์ชัน การเก็บคอนเท็กซ์ การทำ RAG การออกแบบเวิร์กโฟลว์ การกำหนดสิทธิ์การเข้าถึง ตลอดจนการเก็บล็อกและมอนิเตอร์ต้นทุน

Dify ถูกออกแบบมาเพื่อทำให้งานด้าน LLM Ops เป็นเรื่องที่เริ่มต้นได้เร็วและจับต้องได้มากขึ้น โดยเน้นการสร้างแอป LLM สำหรับใช้งานจริง มากกว่าการทำต้นแบบเพื่อทดลองเพียงอย่างเดียว

ทำไม Dify ถึงน่าสนใจสำหรับทีมที่เริ่มทำ AI

จุดเด่นของ Dify คือการรวบองค์ประกอบสำคัญของการทำแอป AI ไว้ในแพลตฟอร์มเดียว ช่วยลดภาระในการต่อระบบเองทีละส่วน และทำให้ทีมสามารถพัฒนาได้เป็นขั้นตอน ตั้งแต่การสร้างต้นแบบไปจนถึงการใช้งานจริง

สำหรับมือใหม่ ประโยชน์ที่เห็นได้ทันทีคือสามารถเริ่มจาก UI ก่อน แล้วค่อยเพิ่มการควบคุมผ่านโค้ดภายหลังได้ วิธีนี้ช่วยให้ทีมเริ่มต้นได้ไว ไม่ต้องวางระบบทุกอย่างเองตั้งแต่วันแรก

ฟีเจอร์สำคัญที่ช่วยให้งาน LLM Ops ง่ายขึ้น

1. สร้างแชตบอทและเอเจนต์ผ่าน UI

Dify เปิดทางให้สร้างแชตบอทหรือเอเจนต์จากหน้า UI ได้โดยตรง เริ่มจากเทมเพลต ปรับ system prompt กำหนดพฤติกรรมของบอท และค่อยเสริมความสามารถเพิ่มเติมผ่าน tools ภายหลัง วิธีนี้เหมาะกับทีมที่ต้องการเริ่มต้นเร็วและค่อยขยายระบบเมื่อความต้องการชัดเจนขึ้น

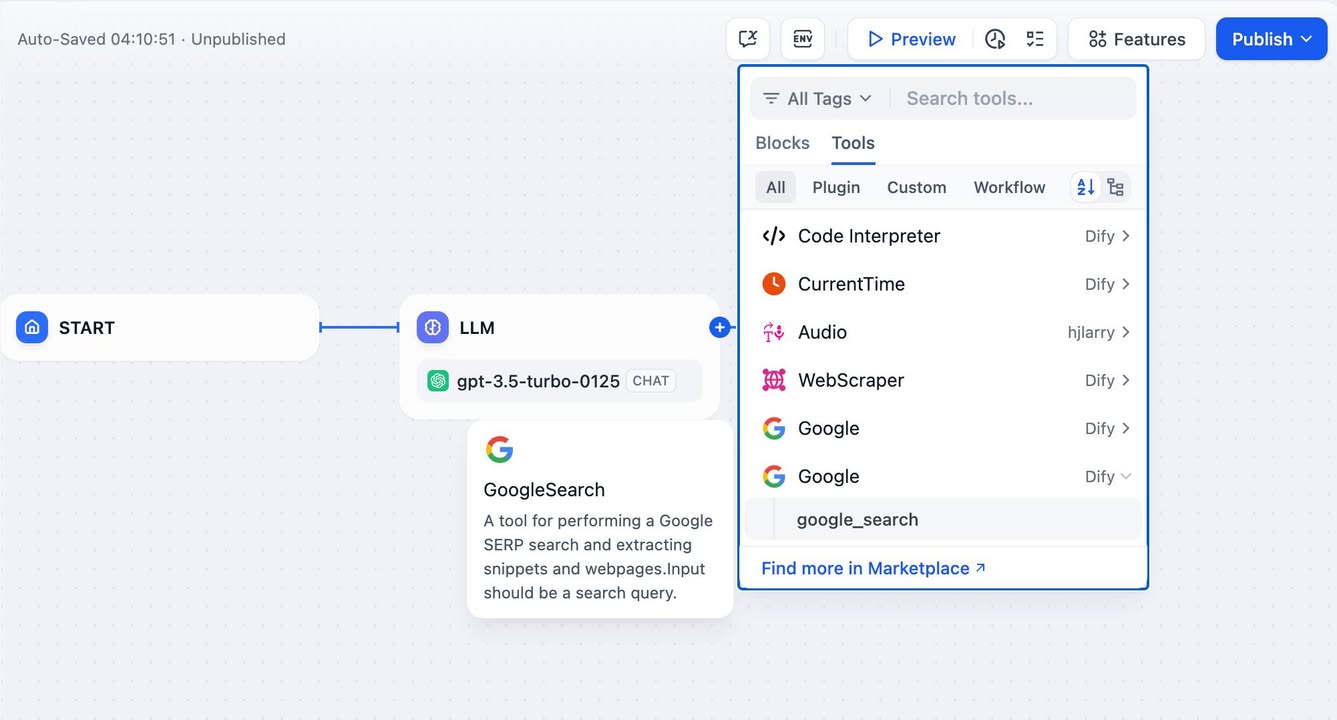

2. เวิร์กโฟลว์แบบลากวาง

อีกหนึ่งความสามารถที่โดดเด่นคือระบบ workflow แบบลากวาง ซึ่งช่วยให้ AI ไม่ได้มีหน้าที่แค่ตอบคำถาม แต่สามารถทำงานเป็นลำดับขั้นได้ เช่น รับคำถามจากผู้ใช้ ตรวจสอบภาษาและหมวดหมู่ เรียกข้อมูลจาก RAG ต่อด้วยค้นข้อมูลจากระบบภายใน แล้วจึงสรุปคำตอบพร้อมแหล่งอ้างอิง

แนวคิดนี้ช่วยให้การตอบของ AI มีโครงสร้างมากขึ้น ลดการตอบแบบเดาสุ่ม และเหมาะกับงานที่ต้องอาศัยหลายขั้นตอนก่อนให้คำตอบสุดท้าย

3. รองรับ RAG สำหรับใช้งานกับเอกสารองค์กร

Dify ช่วยให้การทำ Retrieval-Augmented Generation หรือ RAG เป็นเรื่องง่ายขึ้น ตั้งแต่การอัปโหลดหรือเชื่อมต่อแหล่งข้อมูล การแบ่งเอกสารออกเป็นชิ้นย่อย การทำ embedding ไปจนถึงการค้นคืนข้อมูลที่เกี่ยวข้องก่อนส่งให้โมเดลตอบ

ประเด็นสำคัญที่หลายคนมักมองข้ามคือการกำหนดขนาด chunk ของเอกสาร ซึ่งไม่ใช่ว่ายิ่งใหญ่ยิ่งดี แต่ควรสัมพันธ์กับหน่วยความหมายของเนื้อหา เช่น เอกสารประเภทคู่มือขั้นตอนมักเหมาะกับ chunk ที่สั้นกว่าเอกสารเชิงอธิบายหรือบทความ

4. จัดการพรอมป์ต์และเวอร์ชันได้แบบโปรดักชัน

หนึ่งในปัญหาคลาสสิกของทีมที่พัฒนาแอป AI คือการแก้พรอมป์ต์ในโค้ดแล้วต้องดีพลอยใหม่ทุกครั้ง Dify ช่วยให้จัดการพรอมป์ต์และเวอร์ชันได้เป็นระบบ สามารถทำหลายเวอร์ชันเพื่อทดลองแบบ A/B test หรือย้อนกลับไปใช้เวอร์ชันเดิมเมื่อคุณภาพตกลง

แนวทางนี้ช่วยให้การปรับปรุงคุณภาพคำตอบทำได้ต่อเนื่องและควบคุมได้ง่ายขึ้น

5. เชื่อมต่อเครื่องมือภายนอกได้สะดวก

Dify รองรับการเชื่อมต่อ tools หรือระบบภายนอก เช่น API ภายในองค์กร ฐานข้อมูล ระบบส่งอีเมล CRM หรือระบบซัพพอร์ต แนวคิดสำคัญคือให้ LLM เลือกใช้เครื่องมือที่เหมาะสมเพื่อดึงข้อมูลจริง แทนการคาดเดาคำตอบเอง ซึ่งช่วยลดปัญหา hallucination ได้อย่างมีนัยสำคัญ

สิ่งที่ควรรู้ก่อนนำไปใช้จริง

1. วางแผนความปลอดภัยข้อมูลตั้งแต่ต้น

หากองค์กรต้องอัปโหลดเอกสารหรือเชื่อมข้อมูลภายใน ควรประเมินตั้งแต่แรกว่าเอกสารเหล่านั้นมีข้อมูลส่วนบุคคลหรือข้อมูลอ่อนไหวหรือไม่ ต้องทำ masking หรือไม่ และจำเป็นต้องแยก workspace ตามทีมหรือระดับสิทธิ์การเข้าถึงหรือเปล่า

การวางกติกาด้านข้อมูลตั้งแต่ช่วงเริ่มต้น จะช่วยลดความเสี่ยงในระยะยาวได้มาก

2. กำหนด guardrail ให้ชัดเจน

ระบบ AI ที่ดีไม่จำเป็นต้องตอบได้ทุกคำถามเสมอไป ในหลายกรณี การกำหนดว่าเมื่อค้นข้อมูลไม่เจอให้ตอบว่า “ไม่มีข้อมูล” และต้องแนบแหล่งอ้างอิงทุกครั้ง จะทำให้ผลลัพธ์มีความเสถียรและน่าเชื่อถือมากกว่าการบังคับให้ระบบตอบทุกครั้ง

3. ให้ความสำคัญกับ observability ตั้งแต่ MVP

แม้บอทจะตอบได้ดีในเดโม แต่สิ่งที่สำคัญสำหรับโปรดักชันคือการควบคุมคุณภาพอย่างต่อเนื่อง ดังนั้นควรเก็บข้อมูลสำคัญ เช่น log ของคำถาม เอกสารที่ถูกดึงมาใช้ เวลา latency และปริมาณ token usage เพื่อใช้ตรวจสอบ วิเคราะห์ และปรับปรุงระบบภายหลัง

เทคนิคที่ช่วยยกระดับคุณภาพคำตอบ

ตอบพร้อมแหล่งอ้างอิง

เทคนิคที่ได้ผลชัดเจนคือให้ระบบสรุปคำตอบเป็น bullet สั้น ๆ แล้วแนบลิงก์ ชื่อเอกสาร หรือย่อหน้าที่อ้างอิง วิธีนี้ช่วยเพิ่มความเชื่อมั่นของผู้ใช้ และยังทำให้ทีมงานสามารถตรวจสอบความถูกต้องของคำตอบได้รวดเร็วขึ้น

ตัดสินใจก่อนตอบ

อีกเทคนิคหนึ่งคือการให้โมเดลจัดหมวดหมู่คำถามก่อน เช่น คำถามด้านนโยบาย วิธีใช้งาน หรือปัญหาเทคนิค จากนั้นจึงส่งไปยัง workflow ที่เหมาะกับแต่ละประเภท วิธีนี้ช่วยลดการค้นข้อมูลผิดแหล่ง และลดค่าใช้จ่ายจากการเรียกใช้โมเดลขนาดใหญ่โดยไม่จำเป็น

Dify เหมาะกับใคร

Dify เหมาะกับทั้งมือใหม่ที่อยากเริ่มทำแอป AI แบบพร้อมใช้งานจริง และทีมที่ต้องการลดเวลาในการเชื่อมระบบหลายส่วนเข้าด้วยกัน หากเป้าหมายของคุณไม่ใช่แค่ทำเดโม แต่ต้องการไปสู่ระบบที่ดูแลคุณภาพได้ ขยายต่อได้ และควบคุมต้นทุนได้ดีขึ้น Dify ถือเป็นตัวเลือกที่น่าสนใจมาก

สรุป

Dify คือแพลตฟอร์มโอเพนซอร์สที่ช่วยรวมองค์ประกอบสำคัญของงาน LLM App ไว้ในที่เดียว ไม่ว่าจะเป็นแชตบอท, RAG, เวิร์กโฟลว์, tools, การจัดการเวอร์ชันพรอมป์ต์ และการมอนิเตอร์ระบบ

สำหรับทีมที่ต้องการขยับจาก “เดโม” ไปสู่ “ระบบใช้งานจริง” ได้เร็วขึ้น Dify เป็นเครื่องมือที่ช่วยลดความซับซ้อนและทำให้งาน LLM Ops เป็นเรื่องที่เริ่มต้นและบริหารจัดการได้ง่ายขึ้นอย่างมาก